En el evento se exploraron ejemplos de sesgos raciales y de género en la IA, sus orígenes y formas de mitigarlos.

La directora de GobLab, María Paz Hermosilla, fue la encargada de dictar la cuarta charla del ciclo organizado en conjunto con el Centro de Economía y Política Regional (CEPR) de la Escuela de Negocios UAI.

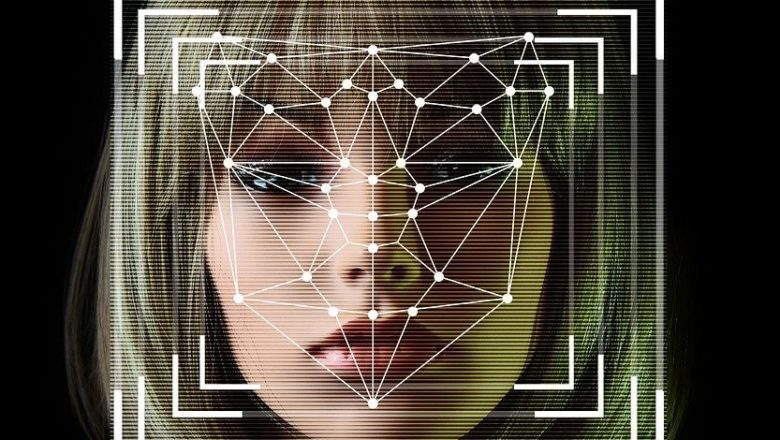

“Sesgos en la Inteligencia Artificial (IA)” fue el nombre de esta presentación en donde se intentó responder por qué estos ocurren, qué consecuencias podrían tener para grupos de la sociedad y cómo mitigar sus efectos.

Para abordar esta temática la académica presentó el caso “Gender Shades” de Joy Buolamwini del MIT, que nació de una experiencia personal negativa de la autora con sistemas de IA y cuya investigación de doctorado generó cambios en las práctica de las industrias que desarrollan tecnologías de IA.

El ejercicio de Buolamwini consistía en tomar varias fotos de rostros de parlamentarios de varios países con diferentes colores de piel e introducirlos en los softwares de reconocimiento facial de 3 empresas, Microsoft, Face++ e IBM. Cuando se evaluaba el desempeño de los software sobre toda la base de datos, eran bastante acertados, sin embargo en el análisis por subgrupos como rostros de mujeres y rostros de personas con tez más oscura, estos softwares tenían un peor desempeño, con hasta un 34% de diferencia en el desempeño a la hora de reconocer rostros de mujeres de tez más oscura, en comparación con rostros de hombres de tez clara.

Según la académica de GobLab esto es muy relevante porque “cuando estos softwares se masifican por el mundo pueden tener muchos efectos y si se utilizan para por ejemplo admitir personas en lugares, pueden tener importantes efectos sobre otros derechos y discriminar a personas sólo por una tez distinta o porque son mujeres u hombres”.

Hermosilla también aclaró que los sistemas de IA “son sistemas sociotécnicos, tienen tecnología que interactúa con personas, con reglas, con instituciones y todo esto se convierte en un conjunto en donde ocurren estas decisiones y en ese sentido los sesgos ocurren por la interacción de todas estas partes, pueden estar dentro del algoritmo, en la interacción de este con el ser humano, pueden venir desde los datos, etc”, comentó la académica.

La charla online se realizó a través de la plataforma Zoom y contó con más de 120 espectadores, estos pudieron participar activamente haciendo preguntas y votando con la herramienta Mentimeter.